GitHub Copilot é o primeiro produto actual baseado em grandes modelos de linguagem

[ad_1]

Este artigo é parte de nossa série que explora a negócios de inteligência synthetic

Desde o GPT-2, tem havido muito entusiasmo em torno das aplicações de grandes modelos de linguagem. E nos últimos anos, vimos LLMs sendo usados para muitas tarefas interessantes, como escrever artigos, projetar websites, criar imagens e até escrever código.

Mas, como argumentei antes, há uma espaço largo entre mostrar uma nova tecnologia fazendo algo criminal e usar a mesma tecnologia para criar um produto de sucesso com um modelo de negócios viável.

A Microsoft, european acho, acaba de lançar o primeiro produto LLM actual com o lançamento público do GitHub Copilot Semana Anterior. Esta é uma aplicação que tem um area of expertise ajuste produto/mercado, tem imenso valor agregado, é difícil de superar, é econômica, tem canais de distribuição muito fortes e pode se tornar uma fonte de grande lucro.

O lançamento do GitHub Copilot é um lembrete de duas coisas: primeiro, os LLMs são fascinantes, mas são úteis quando aplicados a tarefas específicas em vez de inteligência geral synthetic. E segundo, a natureza dos LLMs coloca grandes empresas de tecnologia como Microsoft e Google em uma vantagem injusta comercializá-los — os LLMs não são democráticos.

LLM especializado

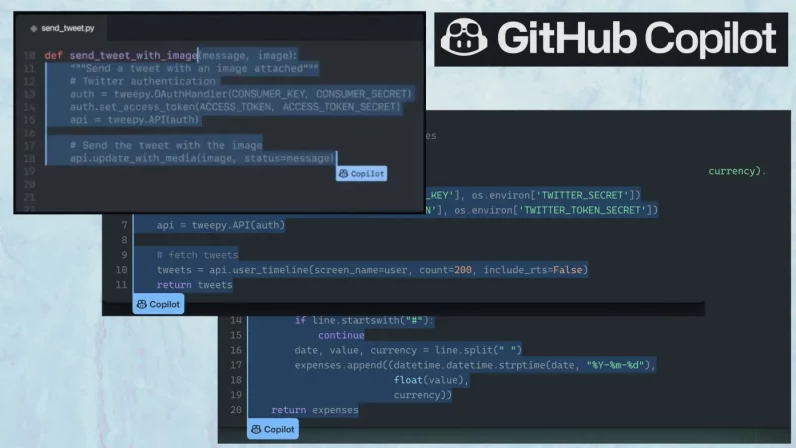

Copiloto é um Ferramenta de programação de IA que é instalado como uma extensão em IDEs populares como Visible Studio e VS Code. Ele fornece sugestões à medida que você escreve o código, algo como preenchimento automático, mas para programação. Seus recursos vão desde completar uma linha de código até criar blocos inteiros de código, como funções e categories.

Copilot é alimentado por Códiceuma versão de O famoso modelo GPT-3 da OpenAI, um grande modelo de linguagem que ganhou as manchetes por sua capacidade de realizar uma ampla gama de tarefas. No entanto, ao contrário do GPT-3, o Codex foi ajustado apenas para tarefas de programação. E produz resultados impressionantes.

O sucesso do GitHub Copilot e Codex sublinha um fato importante. Quando se trata de colocar LLMs em uso actual, a especialização supera a generalização. Quando o Copilot foi introduzido pela primeira vez em 2021, CNBC informou: “…quando o OpenAI estava treinando pela primeira vez [GPT-3]a start-up não tinha a intenção de ensiná-la a ajudar a codificar, [OpenAI CTO Greg] disse Brockmann. Foi concebido mais como um modelo de linguagem de uso geral [emphasis mine] que poderia, por exemplo, gerar artigos, corrigir gramática incorreta e traduzir de um idioma para outro.”

Mas enquanto o GPT-3 obteve um sucesso moderado em várias aplicações, o Copilot e o Codex provaram ser grandes sucessos em uma área específica. Codex não pode escrever poesia ou artigos como GPT-3, mas provou ser muito útil para desenvolvedores de diferentes níveis de especialização. O Codex também é muito menor que o GPT-3, o que significa que é mais eficiente em termos de memória e computação. E dado que foi treinado para uma tarefa específica em oposição ao mundo aberto e ambíguo da linguagem humana, é menos propenso ao armadilhas que modelos como o GPT-3 geralmente caem.

Vale ressaltar, no entanto, que assim como GPT-3 não sabe nada sobre linguagem humana, Copilot não sabe nada sobre código de computador. É um modelo de transformador que foi treinado em milhões de repositórios de código. Dado um suggested (por exemplo, um pedaço de código ou uma descrição textual), ele tentará prever a próxima sequência de instruções que faz mais sentido.

Com seu enorme corpus de treinamento e enorme rede neural, o Copilot geralmente faz boas previsões. Mas, às vezes, pode cometer erros idiotas que o programador mais novato evitaria. Ele não pensa em programas como um programador pensa. Ele não pode projetar device ou pensar em etapas e pensar nos requisitos e na experiência do usuário e em todas as outras coisas que envolvem a criação de aplicativos bem-sucedidos. Isso é não é um substituto para programadores humanos.

Ajuste de produto/mercado da Copilot

Um dos marcos para qualquer produto é atingir o product/marketplace are compatible, ou provar que ele pode resolver algum problema melhor do que soluções alternativas no mercado. A este respeito, Copilot tem sido um sucesso impressionante.

O GitHub lançou o Copilot como um produto de pré-visualização em junho passado e desde então tem sido usado por mais de um milhão de desenvolvedores.

De acordo com o GitHub, nos arquivos em que o Copilot é ativado, ele representa cerca de impressionantes 40% do código escrito. Desenvolvedores e engenheiros com quem falei semana passada dizem que, embora haja limites para os recursos do Copilot, não há como negar que ele melhora significativamente sua produtividade.

Para alguns casos de uso, o Copilot está competindo com o StackOverflow e outros fóruns de código, onde os usuários devem procurar a solução para um problema específico que enfrentam. Neste caso, o valor agregado do Copilot é muito evidente e palpável: menos frustração e distração, mais foco. Em vez de deixar seu IDE e procurar uma solução na internet, os desenvolvedores apenas digitam a descrição ou docstring da funcionalidade que desejam, e o Copilot faz a maior parte do trabalho para eles.

Em outros casos, o Copilot está competindo contra a escrita guide de código frustrante, como configurar gráficos matplotlib em Python (uma tarefa tremendous frustrante). Embora a saída do Copilot possa exigir alguns ajustes, ela alivia a maior parte da carga dos desenvolvedores.

Em muitos outros casos de uso, o Copilot conseguiu se consolidar como uma solução awesome para problemas que muitos desenvolvedores enfrentam todos os dias. Os desenvolvedores me falaram sobre coisas como executar casos de teste, configurar servidores internet, documentar código e muitas outras tarefas que anteriormente exigiam esforço guide e eram árduas. O Copilot os ajudou a economizar muito pace em seu trabalho diário.

Distribuição e custo-benefício

Product/marketplace are compatible é apenas um dos vários componentes da criação de um produto de sucesso. Se você tem um bom produto, mas não consegue encontrar os canais de distribuição certos para entregar seu valor de maneira econômica e lucrativa, você está condenado. Ao mesmo pace, você precisará de um plano para manter sua vantagem sobre os concorrentes, impedir que outras empresas repliquem seu sucesso e garantir que você possa continuar agregando valor ao longo do pace.

Para transformar o Copilot em um produto de sucesso, a Microsoft precisava reunir várias peças muito importantes, incluindo tecnologia, infraestrutura e mercado.

Primeiro, precisava da tecnologia certa, que adquiriu graças à sua licença exclusiva para a tecnologia da OpenAI. Desde 2019, a OpenAI interrompeu o código aberto de sua tecnologia e está licenciando-a para seus financiadores, entre eles a Microsoft. Codex e Copilot foram criados a partir do GPT-3 com a ajuda dos cientistas da OpenAI.

Outras grandes empresas de tecnologia conseguiram criar grandes modelos de linguagem comparáveis ao GPT-3. Mas não há como negar que os LLMs são muito caro para treinar e executar.

“Para um modelo 10 vezes menor que o Codex – o modelo por trás do Copilot (que tem 12B parâmetros no papel) – são necessários centenas de dólares para fazer a avaliação neste referência que eles usaram em seu artigo”, disse Loubna Ben Allal, engenheira de aprendizado de máquina da Hugging Face, ao TechTalks. Ben Allal se referiu outra referência usado para avaliação do Codex, que custou milhares de dólares para seu próprio modelo menor.

“Também há problemas de segurança porque você tem que executar programas não confiáveis para avaliar o modelo que pode ser malicioso, sandboxes são normalmente usadas para segurança”, disse Ben Allal.

Leandro von Werra, outro engenheiro de ML da Hugging Face, estimou os custos de treinamento entre dezenas e centenas de milhares de dólares, dependendo do tamanho e do número de experimentos necessários para acertar.

“A inferência é um dos maiores desafios”, acrescentou von Werra em comentários ao TechTalks. “Embora quase qualquer pessoa com recursos possa treinar um modelo 10B hoje em dia, obter a latência de inferência baixa o suficiente para se sentir responsivo ao usuário é um desafio de engenharia.”

É aí que entra a segunda vantagem da Microsoft. A empresa conseguiu criar uma grande infraestrutura de nuvem especializada em modelos de aprendizado de máquina, como o Codex. Ele executa inferência e fornece sugestões em milissegundos. E, mais importante, a Microsoft é capaz de executar e fornecer o Copilot a um preço muito acessível. Atualmente, o Copilot é oferecido por US$ 10/mês ou US$ 100/ano e será fornecido gratuitamente para estudantes e mantenedores de repositórios populares de código aberto.

A maioria dos desenvolvedores com quem conversei ficou muito satisfeita com o modelo de preços porque os fez muito mais do que seu preço em pace economizado.

Abhishek Thakur, outro engenheiro de ML da Hugging Face com quem conversei no início desta semana, disse: “Como engenheiro de aprendizado de máquina, sei que muito é necessário para construir produtos como esses, especialmente o Copilot, que fornece sugestões com latência de menos de milissegundos. Construir uma infraestrutura que atende a esses tipos de modelos gratuitamente não é viável no mundo actual por um longo período de pace.”

No entanto, executar LLMs geradores de código a preços acessíveis não é impossível.

“Em termos de computação para construir esses modelos e dados necessários: isso é bastante viável e houve algumas replicações do Codex, como o Incoder da Meta e CodeGen (agora acessível gratuitamente no Hugging Face Hub) do Salesforce que corresponde ao desempenho do Codex”, disse von Werra. “Definitivamente, há alguma engenharia envolvida na construção dos modelos em um produto rápido e agradável, mas parece que muitas empresas podem fazer isso se quiserem.”

No entanto, é aqui que a terceira peça do quebra-cabeça entra em ação. A aquisição do GitHub pela Microsoft deu acesso ao maior mercado de desenvolvedores, tornando mais fácil para a empresa colocar o Copilot nas mãos de milhões de usuários. A Microsoft também possui o Visible Studio e o VS Code, dois dos IDEs mais populares com centenas de milhões de usuários. Isso reduz o atrito para os desenvolvedores adotarem o Copilot em oposição a outro produto equivalent.

Com seus preços, eficiência e alcance de mercado, a Microsoft parece ter solidificado sua posição como líder no mercado emergente de desenvolvimento de device assistido por IA. O mercado pode tomar outros rumos. O que é certo (e como já disse antes) é que grandes modelos de linguagem abrirão muitas oportunidades para criar novos aplicativos e mercados. Mas eles não vão mudar os fundamentos de um bom gerenciamento de produtos.

Este artigo foi originalmente publicado por Ben Dickson em TechTalks, uma publicação que examina as tendências em tecnologia, como elas afetam a maneira como vivemos e fazemos negócios e os problemas que elas resolvem. Mas também discutimos o lado maligno da tecnologia, as implicações mais sombrias da nova tecnologia e o que precisamos observar. Você pode ler o artigo unique aqui.

[ad_2]

Fonte da Notícia: thenextweb.com