O viés de IA pode surgir de instruções de anotação – TechCrunch

[ad_1]

A pesquisa no campo de aprendizado de máquina e IA, agora uma tecnologia-chave em praticamente todos os setores e empresas, é volumosa demais para que qualquer um leia tudo. Esta coluna, Perceptron (anteriormente Ciência Profunda), visa coletar algumas das descobertas e artigos recentes mais relevantes — particularmente, mas não limitado a, inteligência synthetic — e explicar por que eles são importantes.

Esta semana em IA, um novo estudo revela como o viés, um problema comum em sistemas de IA, pode começar com as instruções dadas às pessoas recrutadas para anotar dados a partir dos quais os sistemas de IA aprendem a fazer previsões. Os coautores descobriram que os anotadores captam padrões nas instruções, o que os condiciona a contribuir com anotações que se tornam super-representadas nos dados, influenciando o sistema de IA para essas anotações.

Muitos sistemas de IA hoje “aprendem” a entender imagens, vídeos, texto e áudio a partir de exemplos que foram rotulados por anotadores. Os rótulos permitem que os sistemas extrapolem as relações entre os exemplos (por exemplo, o hyperlink entre a legenda “pia de cozinha” e uma foto de uma pia de cozinha) para dados que os sistemas não viram antes (por exemplo, fotos de pias de cozinha que foram não incluído nos dados usados para “ensinar” o modelo).

Isso funciona notavelmente bem. Mas a anotação é uma abordagem imperfeita – os anotadores trazem vieses para a mesa que podem sangrar no sistema treinado. Por exemplo, estudos mostraram que a anotador médio é mais provável que rotule frases em inglês vernacular afro-americano (AAVE), a gramática casual usada por alguns negros americanos, como tóxicas, levando os detectores de toxicidade de IA treinados nos rótulos a ver o AAVE como desproporcionalmente tóxico.

Como se vê, as predisposições dos anotadores podem não ser as únicas culpadas pela presença de viés nos rótulos de treinamento. Em uma pré-impressão estudar da Arizona State College e do Allen Institute for AI, pesquisadores investigaram se uma fonte de viés pode estar nas instruções escritas por criadores de conjuntos de dados para servir como guias para anotadores. Essas instruções geralmente incluem uma breve descrição da tarefa (por exemplo, “Etiquete todas as aves nestas fotos”) juntamente com vários exemplos.

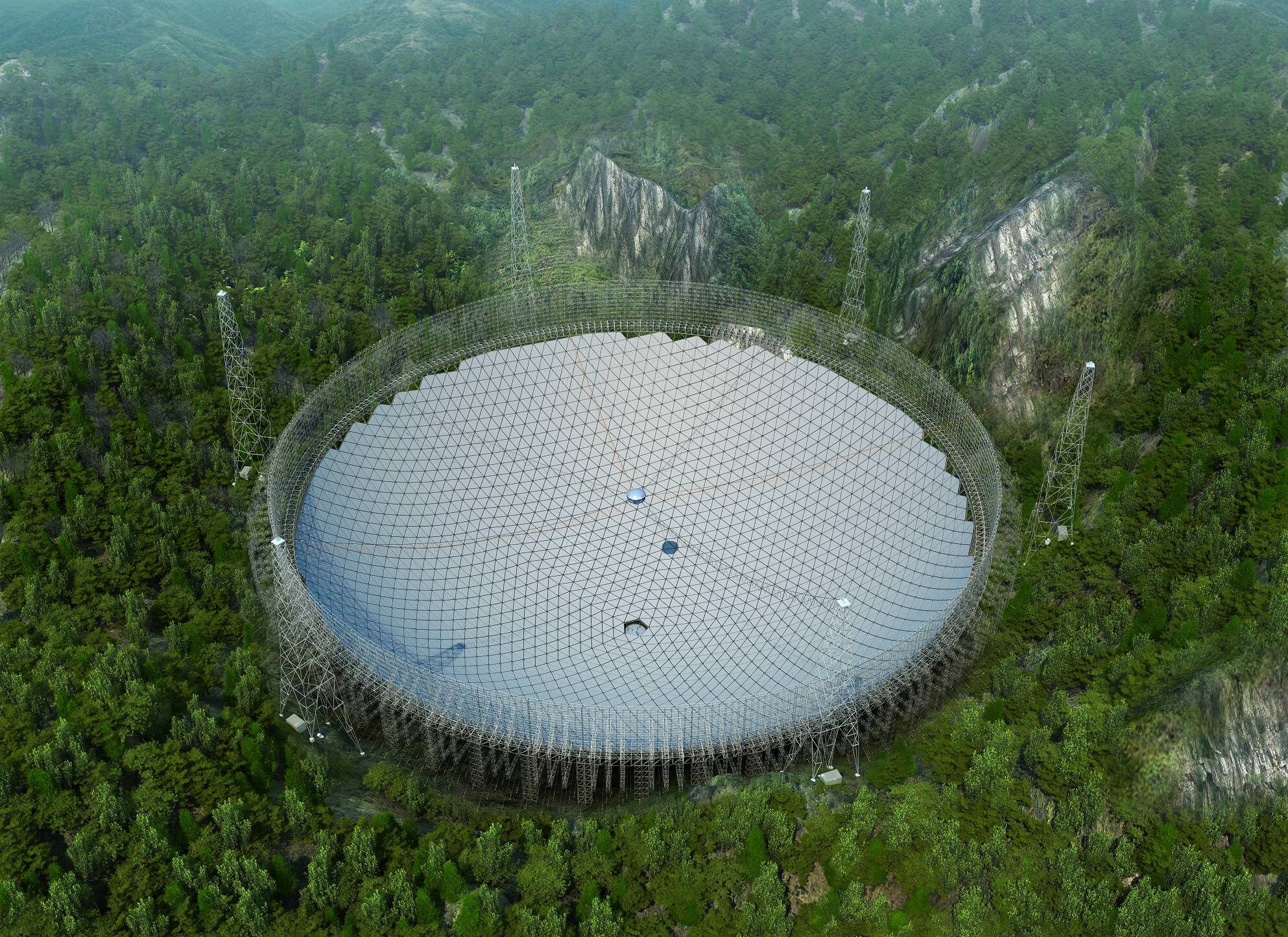

Créditos da imagem: Parmar et ai.

Os pesquisadores analisaram 14 conjuntos de dados de “benchmark” diferentes usados para medir o desempenho de sistemas de processamento de linguagem herbal, ou sistemas de IA que podem classificar, resumir, traduzir e analisar ou manipular texto. Ao estudar as instruções de tarefas fornecidas aos anotadores que trabalhavam nos conjuntos de dados, eles encontraram evidências de que as instruções influenciaram os anotadores a seguir padrões específicos, que então se propagaram para os conjuntos de dados. Por exemplo, mais da metade das anotações no Quoref, um conjunto de dados projetado para testar a capacidade dos sistemas de IA de entender quando duas ou mais expressões se referem à mesma pessoa (ou coisa), começam com a frase “Qual é o nome?” uma frase presente em um terço das instruções para o conjunto de dados.

O fenômeno, que os pesquisadores chamam de “viés de instrução”, é particularmente preocupante porque sugere que sistemas treinados em dados tendenciosos de instrução/anotação podem não funcionar tão bem quanto se pensava inicialmente. De fato, os coautores descobriram que o viés de instrução superestima o desempenho dos sistemas e que esses sistemas geralmente não conseguem generalizar além dos padrões de instrução.

O lado positivo é que grandes sistemas, como o GPT-3 da OpenAI, geralmente são menos sensíveis ao viés de instrução. Mas a pesquisa serve como um lembrete de que os sistemas de IA, como as pessoas, são suscetíveis ao desenvolvimento de vieses de fontes que nem sempre são óbvias. O desafio intratável é descobrir essas fontes e mitigar o impacto a jusante.

Em um artigo menos sério, cientistas vindos da Suíça concluiu que os sistemas de reconhecimento facial não são facilmente enganados por rostos realistas editados por IA. Os “ataques de transformação”, como são chamados, envolvem o uso de IA para modificar a foto em um documento de identidade, passaporte ou outra forma de documento de identidade com o objetivo de contornar os sistemas de segurança. Os coautores criaram “morfos” usando IA (Nvidia’s StyleGAN 2) e os testaram em quatro sistemas de reconhecimento facial de última geração. Os metamorfos não representavam uma ameaça significativa, alegaram, apesar de sua aparência realista.

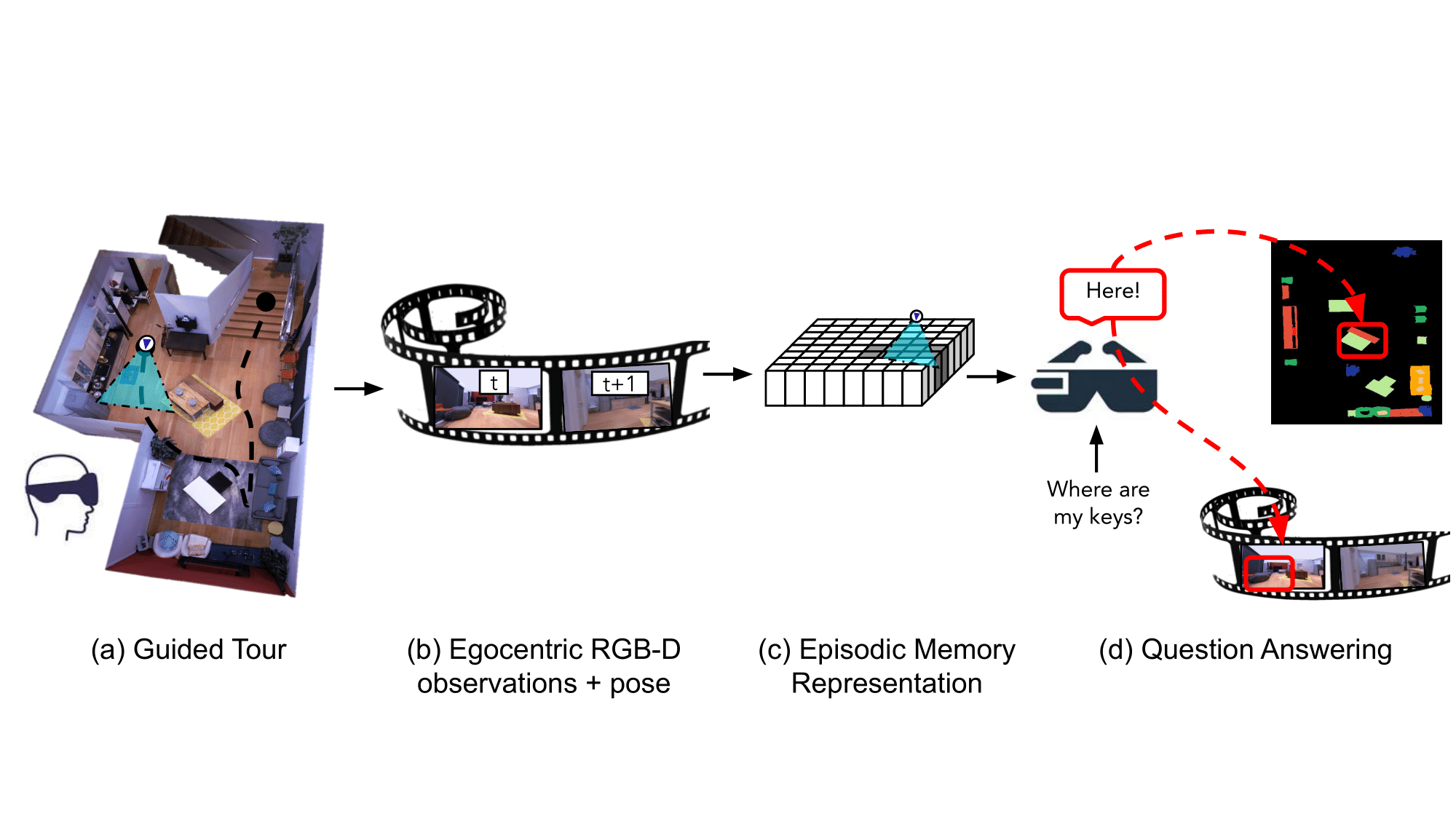

Em outros lugares no domínio da visão computacional, pesquisadores da Meta desenvolveram um “assistente” de IA que pode lembrar as características de uma sala, incluindo a localização e o contexto dos objetos, para responder a perguntas. Detalhado em um papel pré-impresso, o trabalho provavelmente faz parte do trabalho de Meta Projeto Nazaré iniciativa para desenvolver óculos de realidade aumentada que aproveitam a IA para analisar seus arredores.

Créditos da imagem: Meta

O sistema dos pesquisadores, projetado para ser usado em qualquer dispositivo corporal equipado com uma câmera, analisa imagens para construir “memórias de cena semanticamente ricas e eficientes” que “codificam informações espaço-temporais sobre objetos”. O sistema lembra onde os objetos estão e quando eles apareceram no vídeo e, além disso, fundamenta as respostas às perguntas que um usuário pode fazer sobre os objetos em sua memória. Por exemplo, quando perguntado “Onde você viu minhas chaves pela última vez?”, o sistema pode indicar que as chaves estavam em uma mesa lateral na sala naquela manhã.

Meta, que supostamente planeja lançar óculos AR completos em 2024, telegrafou seus planos para IA “egocêntrica” em outubro passado com o lançamento do Ego4D, um projeto de pesquisa de IA de “percepção egocêntrica” de longo prazo. A empresa disse na época que o objetivo technology ensinar os sistemas de IA a – entre outras tarefas – entender pistas sociais, como as ações de um usuário de dispositivo AR podem afetar o ambiente e como as mãos interagem com os objetos.

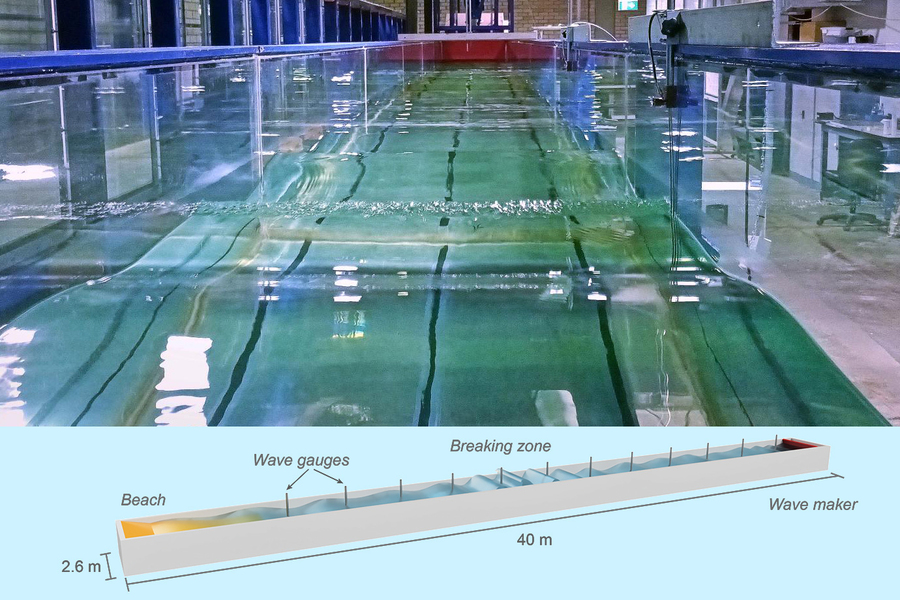

Da linguagem e realidade aumentada aos fenômenos físicos: um modelo de IA foi útil em um estudo do MIT sobre ondas – como elas quebram e quando. Embora pareça um pouco misterioso, a verdade é que os modelos de ondas são necessários tanto para construir estruturas dentro e perto da água quanto para modelar como o oceano interage com a atmosfera em modelos climáticos.

Créditos da imagem: MIT

Normalmente as ondas são aproximadamente simuladas por um conjunto de equações, mas os pesquisadores treinou um modelo de aprendizado de máquina em centenas de instâncias de ondas em um tanque de água de 40 pés cheio de sensores. Ao observar as ondas e fazer previsões com base em evidências empíricas, comparando-as com os modelos teóricos, a IA ajudou a mostrar onde os modelos falharam.

Uma startup está nascendo da pesquisa na EPFL, onde a tese de doutorado de Thibault Asselborn sobre análise de caligrafia tem se transformou em um aplicativo educacional completo. Usando algoritmos que ele projetou, o aplicativo (chamado College Rebound) pode identificar hábitos e medidas corretivas com apenas 30 segundos de uma criança escrevendo em um iPad com uma caneta. Estes são apresentados à criança na forma de jogos que os ajudam a escrever com mais clareza, reforçando os bons hábitos.

“Nosso modelo científico e rigor são importantes e nos diferenciam de outras aplicações existentes”, disse Asselborn em um comunicado à imprensa. “Recebemos cartas de professores que viram seus alunos melhorarem aos trancos e barrancos. Alguns alunos até vêm antes da aula para praticar.”

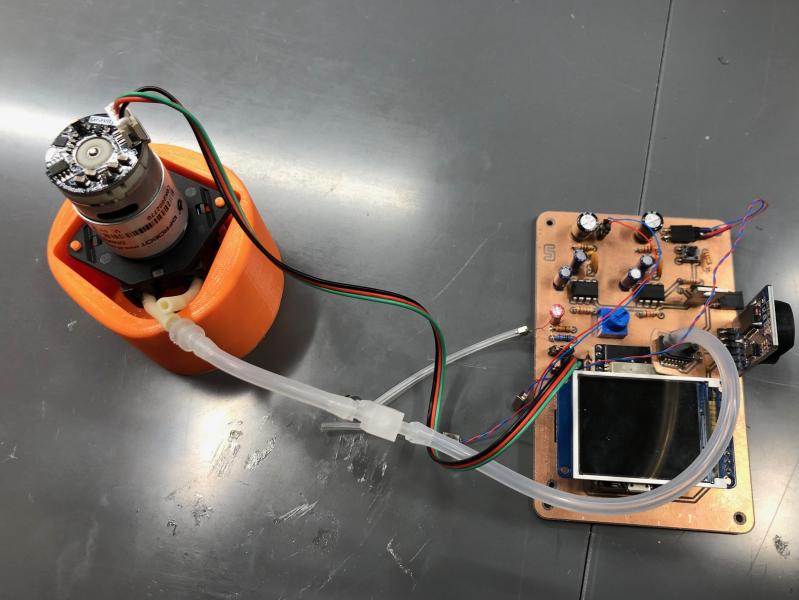

Créditos da imagem: Universidade Duke

Outra novidade no ensino basic tem a ver com a identificação de problemas auditivos durante exames de rotina. Esses exames, que alguns leitores podem se lembrar, costumam usar um aparelho chamado timpanômetro, que deve ser operado por fonoaudiólogos treinados. Se um não estiver disponível, digamos em um distrito escolar isolado, as crianças com problemas de audição podem nunca obter a ajuda de que precisam a pace.

Samantha Robler e Susan Emmett da Duke decidiram construir um timpanômetro que essencialmente opera sozinho, enviando dados para um aplicativo de smartphone onde são interpretados por um modelo de IA. Qualquer coisa preocupante será sinalizada e a criança poderá receber mais triagem. Não substitui um especialista, mas é muito melhor do que nada e pode ajudar a identificar problemas auditivos muito mais cedo em locais sem os recursos adequados.

[ad_2]

Fonte da Notícia